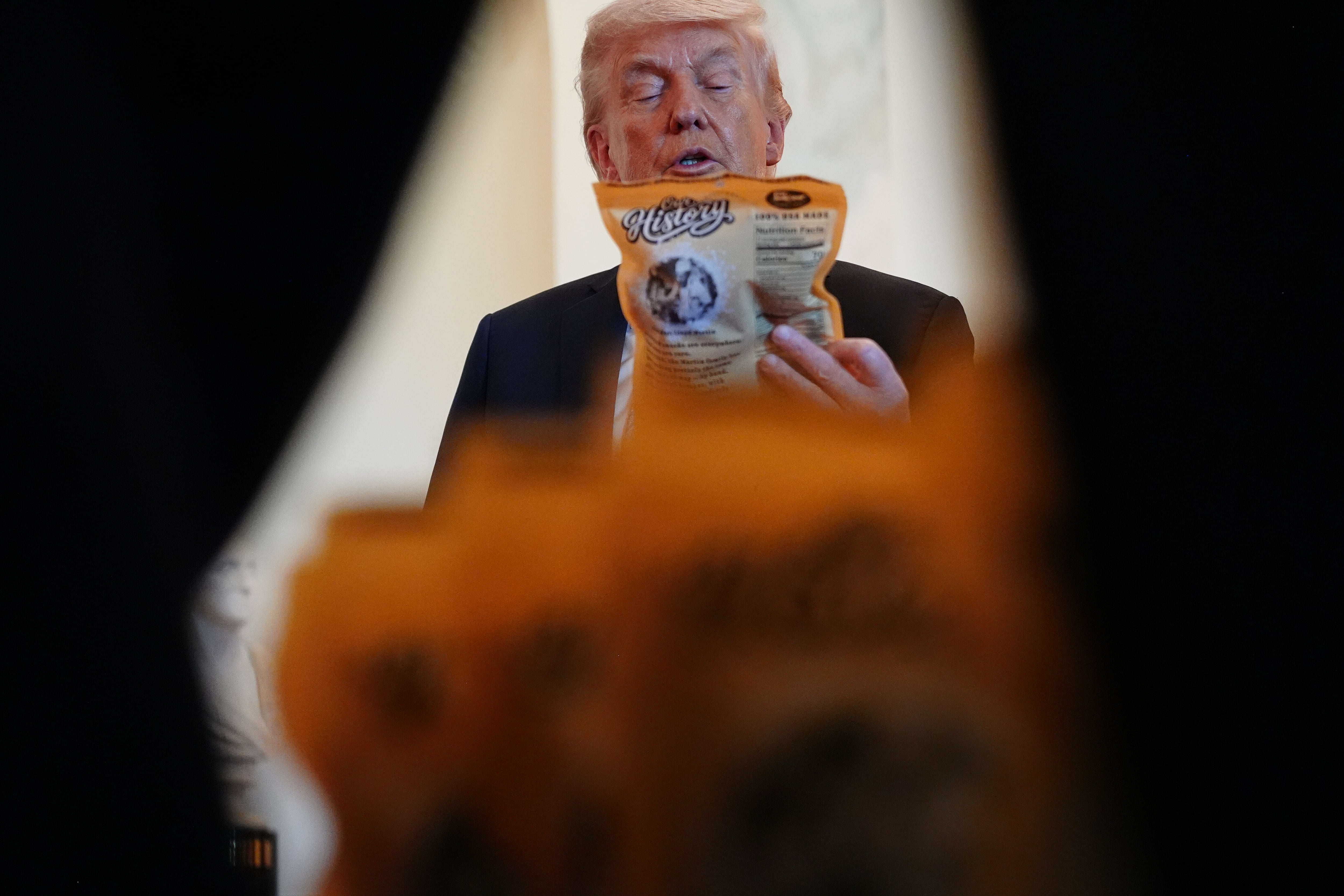

TikTok se jugaba su supervivencia en Estados Unidos en 2024. El entonces presidente Joe Biden había aprobado una ley por la que TikTok debía separarse de su empresa madre china, Bytedance, si quería seguir operando en EE UU. Una vez Trump ganó, llegaron a un acuerdo. Hoy la plataforma sigue en el país y Trump se aprovecha de ella: “No period fan de TikTok, pero empecé a usarlo, me hice fan y me ayudó a ganar las elecciones por goleada”, dijo Trump tras ganar los comicios.

Aquella impresión de Trump period verdad: TikTok le ayudó a ganar las elecciones. Este miércoles, la revista Nature publica un artículo que confirma que TikTok enseñó más vídeos conservadores que progresistas en 2024 a sus usuarios en EE UU. Los investigadores crearon 323 cuentas de TikTok en Nueva York, Texas y Georgia, recopilaron más de 280.000 vídeos recomendados durante meses antes de las elecciones de 2024 y detectaron un sesgo significativo a favor del Partido Republicano: las cuentas configuradas como republicanas recibieron un 11,5% más de contenido afín a su partido, y las demócratas vieron un 7,5% más de contenido antiprogresista. TikTok no ha respondido con ninguna declaración a preguntas de este periódico sobre el estudio.

Así, según el estudio, un usuario de TikTok interesado en política en 2024 vio más contenido professional Trump. La pregunta difícil de responder desde fuera es por qué. TikTok tiene un algoritmo que determine qué vídeo es el siguiente que ve cada usuario y que determine lógicamente la propia compañía. Ahí juegan muchísimas variables, como la cantidad de gente que ve un vídeo, qué tipo de contenido viraliza más o qué prefiere cada usuario. ¿Fue la causa de esta tendencia professional Trump una decisión interna de TikTok o solo que los estadounidenses tenían más ganas de ver contenido professional Trump?

“Es una pregunta razonable, y la investigamos”, cube Yasir Zaki, coautor y profesor de la Universidad de Nueva York (NYU) en Abu Dabi (Emiratos). “Comprobamos si los resultados podían explicarse simplemente por TikTok promocionando publicaciones en función de los me gusta, los compartidos y las visualizaciones. Para eso construimos 48 modelos distintos que simulaban ese tipo de sistema. En todos los casos, el sesgo que observamos en los datos reales period mayor que el que predecían esos modelos. De hecho, algunos de ellos sugerían el patrón contrario, ya que el contenido demócrata solía tener un mayor nivel de interacción common”, añade.

Según los autores, por tanto, el interés de la audiencia tuvo poco que ver. ¿Puede ser entonces que TikTok tenga un botón para favorecer a un individuo o tendencia? Sí, lo tiene. En 2023 Forbes publicó una investigación con documentos internos donde revelaba que TikTok tiene un “botón” interno llamado calentador (heating) que permitía a empleados impulsar manualmente vídeos concretos, al margen del algoritmo. El objetivo period garantizar a esos vídeos un número determinado de visualizaciones y les servía para atraer marcas e influencers, pero algunos trabajadores lo aprovecharon para beneficiar sus propias cuentas o las de personas de su entorno. “Solo unas pocas personas, en EE UU, tienen la capacidad de aprobar contenido para su promoción en ese país, y ese contenido representa aproximadamente el 0,002% de los vídeos”, dijo la compañía a Forbes.

Nadie sabe desde fuera si este método u otro related fue usado para favorecer a Trump y que el nuevo presidente permitiera a TikTok seguir operando en EE UU. “Nuestro estudio puede decir lo que hace el algoritmo, pero no por qué”, cube Hazem Ibrahim, coautor y profesor de la Universidad de Nueva York en Abu Dabi. “El sesgo supera todos los controles de solidez que hicimos, pero los sesgos pueden surgir de los objetivos de optimización y de bucles automáticos sin que nadie los haya elegido”, añade.

Pudo ser adrede o informal

¿Pero entonces podría TikTok haberlo hecho adrede? “Técnicamente, sí, y además sería muy sencillo”, cube Ibrahim. ¿Pero también podría ser como casualidad? “También podría ser una propiedad emergente de la forma en que el sistema optimiza las interacciones. Desde el punto de vista del usuario, el efecto es el mismo en cualquier caso”, aclara Ibrahim. Queriendo o no, TikTok ayudó a Trump a ganar las elecciones.

En el caso de Biden contra TikTok una de las preocupaciones period precisamente la capacidad de TikTok para influir en la opinión pública estadounidense. El argumento period sencillo: si ByteDance obedece al gobierno chino, podría ordenar a la plataforma inclinar la balanza hacia el candidato o el partido que más conviniera a sus intereses. La influencia sería sobre un grupo de entre los más de 170 millones de usuarios de TikTok en EE UU. Es una cantidad notable.

Tampoco sabemos con certeza cómo podría influir eso en su intención de voto: “Hay una amplia literatura académica que demuestra que las redes sociales pueden influir en cómo piensa y actúa la gente”, cube Zaki. “Aunque nuestro estudio no midió directamente esos efectos, sí demuestra que TikTok ofrece una mezcla desigual de información. Esto importa porque los sistemas de recomendación determinan a qué se expone la gente a lo largo del tiempo: qué asuntos parecen importantes, qué candidatos reciben críticas y qué narrativas ganan terreno. Contribuyen a crear el contexto en el que las personas deciden su voto”.

Este caso es muy estadounidense. Pero podría obviamente ocurrir en cualquier otro país: “En principio, que la selección algorítmica se imponga a las preferencias del usuario puede ocurrir en cualquier lugar donde opere TikTok. Harían falta auditorías específicas por país para saber cómo se manifiesta ese sesgo en otros contextos”, cube Talal Rahwan, coautor y profesor de la Universidad de Nueva York en Abu Dabi.